한줄 요약

소스 문장과 관계 레이블을 조건으로 타겟 문장을 생성하는 교차 문장 잠재 변수 모델(CS-LVM)을 제안하여, 자연어 추론 및 패러프레이즈 식별에서 원칙적인 준지도 학습을 가능하게 하고, 다양하고 의미적으로 타당한 생성을 위한 새로운 의미 제약 조건을 도입한 연구입니다.

배경 및 동기

텍스트 시퀀스 매칭 — 함의, 모순, 패러프레이즈 등 두 텍스트 시퀀스 간의 관계를 예측하는 것 — 은 답변 문장 선택, 텍스트 검색, 기계 독해 등의 기반이 되는 핵심 NLP 태스크입니다. 심층 신경망 모델이 이러한 태스크에서 뛰어난 성과를 달성했지만, 대량의 레이블 학습 데이터가 필요하며 이를 구축하는 것은 시간과 노동력이 많이 소요됩니다. 비레이블 데이터를 활용하는 준지도 학습 패러다임이 유망한 해결책을 제시하지만, 기존의 VAE 기반 텍스트 쌍 모델링 접근법은 오토인코딩 프레임워크 내에서 각 문장을 독립적으로 처리하여 생성 모델과 판별 분류기 간의 상호작용이 제한적이었습니다.

기존 연구의 한계: 기존 VAE 기반 준지도 매칭 모델(LSTM-VAE, DeConv-VAE 등)은 쌍의 각 문장을 개별적으로 인코딩하고 재구성합니다. 이는 생성 모델링 과정이 단일 시퀀스 내에 국한되며, 쌍 수준의 정보는 분류기 네트워크를 통해서만 고려됩니다. 비지도 학습 환경에서는 재구성 목적함수만 학습에 사용되므로 분류기 파라미터가 업데이트되지 않아 인코더와 분류기 간의 상호작용이 제한됩니다. 각 문장이 자기 자신의 잠재 변수에 매핑되어 다시 자기 자신으로 복원되므로, 생성 모델은 두 문장 간의 관계를 학습하지 못합니다.

핵심 아이디어: 본 연구는 교차 문장 생성을 제안합니다. 각 문장을 독립적으로 재구성하는 대신, 소스 문장과 주어진 관계를 갖는 타겟 문장을 생성합니다. 이는 실제 데이터셋 구축 과정(예: SNLI에서 주석자가 전제와 레이블이 주어지면 가설을 작성)을 자연스럽게 반영하며, 단일 생성 모델 내에서 두 시퀀스와 레이블을 통합하여 생성과 분류 간의 더 강한 상호작용을 가능하게 합니다.

문제 설정

문장 쌍 데이터셋 {(x_1, x_2)}가 주어지고, 일부 쌍에는 관계 레이블 y(예: NLI의 함의/중립/모순, QQP의 패러프레이즈 여부)가 부여되어 있고 나머지는 레이블이 없는 상황에서, 새로운 문장 쌍에 대해 y를 예측하는 분류기를 학습하는 것이 목표입니다. 대규모 레이블 문장 쌍 데이터셋을 구축하는 비용이 높은 반면 비레이블 텍스트 쌍은 저렴하게 대량 수집 가능하므로, 이러한 준지도 학습 설정은 현실적인 시나리오입니다. 핵심 과제는 생성 구성요소(비레이블 데이터 모델링)와 판별 구성요소(관계 분류)가 공유 표현을 통해 서로를 강화하는 프레임워크를 설계하는 것입니다.

제안 방법

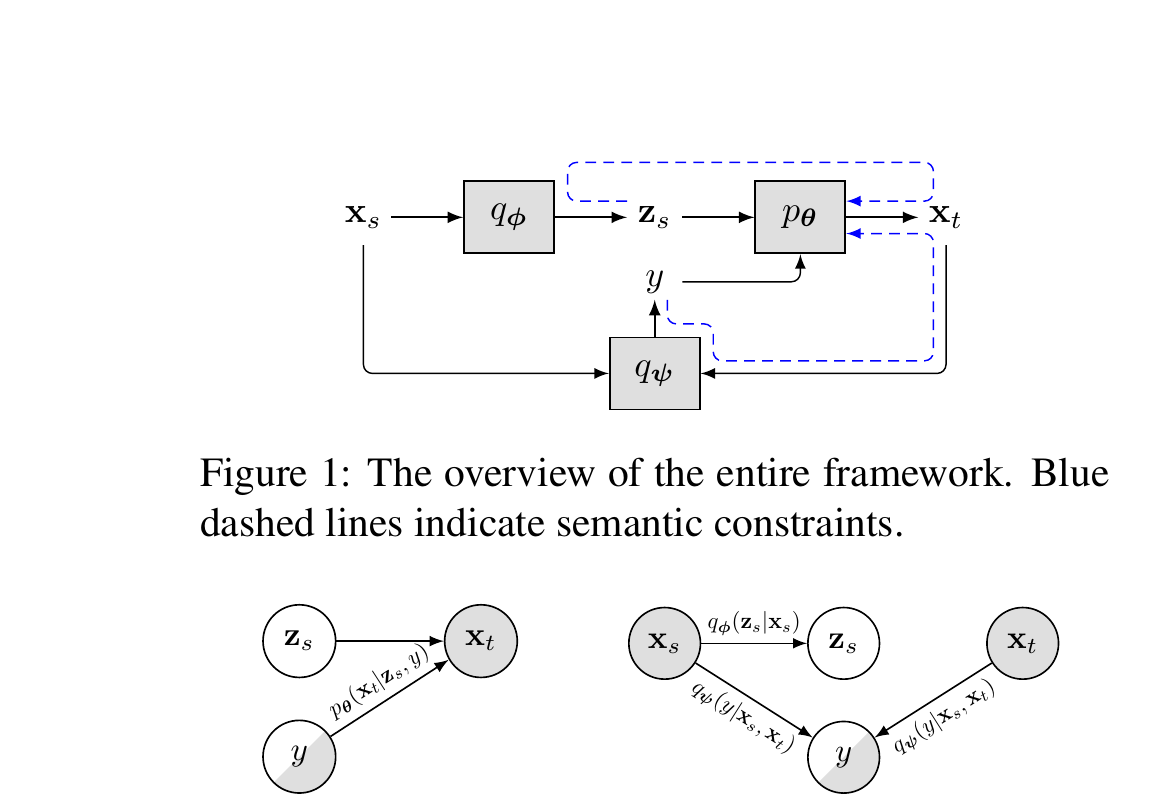

교차 문장 잠재 변수 모델(CS-LVM)은 심층 확률적 생성 모델(VAE)을 기반으로 하되, 개별 문장 내가 아닌 문장 쌍 간에 텍스트를 생성한다는 점에서 기존 접근법과 근본적으로 다릅니다. 잠재 공간에 가우시안 대신 폰 미제스-피셔(vMF) 분포를 사용하여 표준 VAE에 내재된 사후 분포 붕괴(posterior collapse) 문제를 방지합니다.

학습 절차: 학습은 두 단계로 진행됩니다. 1단계 (사전학습): 전체 모델(인코더, 디코더, 분류기)을 지도 및 비지도 ELBO 목적함수의 결합으로 수렴할 때까지 공동 학습합니다. 2단계 (미세조정): 의미 제약 조건 R^y, R^z, R^μ를 손실 함수에 추가하여 모델을 추가로 미세조정합니다. 이 2단계 전략은 의미 제약 조건이 의미 있는 경사 신호를 제공하기 위해 합리적으로 잘 학습된 생성기와 분류기가 필요하기 때문입니다.

실험 결과

모델은 두 가지 준지도 학습 태스크에서 평가되었습니다: 자연어 추론(SNLI, ~570k 쌍, 3-클래스 분류)과 패러프레이즈 식별(Quora Question Pairs, ~400k 쌍, 이진 분류). 기존 연구를 따라 제한된 레이블 부분집합을 사용하고 나머지를 비레이블 데이터로 활용하며, 어휘 크기 20,000, 사전학습 임베딩 미사용 조건으로 실험했습니다. 이러한 통제된 실험 환경은 대규모 사전학습 표현의 효과를 배제하고 준지도 프레임워크 자체의 기여를 분리합니다.

준지도 자연어 추론 (SNLI 데이터셋)

| 모델 | 28k | 59k | 120k |

|---|---|---|---|

| LSTM | 57.9 | 62.5 | 65.9 |

| CNN | 58.7 | 62.7 | 65.6 |

| LSTM-AE | 59.9 | 64.6 | 68.5 |

| LSTM-VAE | 64.7 | 67.5 | 71.1 |

| DeConv-VAE | 67.2 | 69.3 | 72.2 |

| LSTM-vMF-VAE (ours) | 65.6 | 68.7 | 71.1 |

| CS-LVM (ours) | 68.4 | 73.5 | 76.9 |

| CS-LVM + 전체 제약 조건 | 69.6 | 74.1 | 77.4 |

준지도 패러프레이즈 식별 (QQP 데이터셋)

| 모델 | 1k | 5k | 10k | 25k |

|---|---|---|---|---|

| CNN | 56.3 | 59.2 | 63.8 | 68.9 |

| LSTM-AE | 60.2 | 65.1 | 67.7 | 71.6 |

| DeConv-VAE | 65.1 | 69.4 | 70.5 | 73.7 |

| LSTM-vMF-VAE (ours) | 65.0 | 69.9 | 72.1 | 74.9 |

| CS-LVM (ours) | 66.5 | 71.1 | 74.6 | 76.9 |

| CS-LVM + 전체 제약 조건 | 66.3 | 71.3 | 74.7 | 77.6 |

절제 연구: 개별 제약 조건 효과 (SNLI, 59k 레이블)

| 구성 | 정확도 |

|---|---|

| CS-LVM (제약 조건 없음) | 73.5 |

| + R^y만 적용 | 73.8 |

| + R^z만 적용 | 73.6 |

| + R^μ만 적용 | 73.6 |

| + R^y + R^z | 73.9 |

| + R^y + R^z + R^μ (전체) | 74.1 |

절제 연구: 아키텍처 선택 (SNLI, 59k 레이블)

| 변형 | 정확도 |

|---|---|

| CS-LVM (전체) | 73.5 |

| 교차 문장 생성 제거 | 68.7 |

| 인코더 공유 제거 | 70.1 |

| vMF 대신 가우시안 사용 | 72.8 |

생성 품질 분석

| 모델 | 인공 정확도 | Distinct-1 | Distinct-2 |

|---|---|---|---|

| CS-LVM (제약 조건 없음) | 76.5% | 0.042 | 0.170 |

| + R^y | 81.9% | 0.043 | 0.173 |

| + R^y + R^z + R^μ | 81.2% | 0.048 | 0.202 |

인공 정확도는 별도로 학습된 분류기가 생성된 쌍의 관계 레이블을 올바르게 식별하는지를 측정합니다. Distinct-1/2는 전체 토큰 대비 고유 유니그램/바이그램 비율로 생성 다양성을 나타냅니다.

- 두 태스크 모두에서 최고 성능 달성: CS-LVM은 SNLI와 QQP 모두에서 모든 레이블 데이터 설정에서 기존 오토인코딩 기반 모델을 크게 상회하며, 이전 최고 모델(DeConv-VAE) 대비 최대 5포인트 이상의 정확도 향상을 달성. 레이블이 적은 환경에서 격차가 특히 크며, 이는 교차 문장 생성이 레이블 데이터가 부족할 때 특히 효과적임을 확인

- 교차 문장 생성이 핵심 요인: 절제 연구에서 교차 문장 생성을 제거하면(문장 내 오토인코딩으로 회귀) 최대 ~4.8포인트의 가장 큰 성능 하락이 발생. 생성 모델과 분류기 간 인코더 가중치 공유가 두 번째로 중요한 요인(제거 시 ~3.4포인트 하락)

- 의미 제약 조건의 추가 성능 향상: R^y, R^z, R^μ를 활용한 미세조정은 추가적인 성능 향상을 제공. R^y(레이블 일관성)가 생성된 문장이 조건화된 관계를 충실히 반영하도록 보장하여 가장 큰 정확도 향상에 기여하고, R^z와 R^μ는 주로 distinct-1/distinct-2 지표로 측정되는 생성 다양성을 향상

- 완전 지도 학습에서도 이점: SNLI 전체 ~550k 레이블을 사용해도 CS-LVM은 82.8% 정확도를 달성하여 지도 학습 LSTM(81.5%), LSTM-AE(81.6%), DeConv-VAE(80.9%)를 상회, 교차 문장 생성 프레임워크가 비레이블 데이터가 필요하지 않은 경우에도 더 나은 귀납적 편향을 제공함을 시사

- vMF vs. 가우시안: vMF를 가우시안으로 대체하면 정확도가 소폭 하락(73.5 vs. 72.8)하며, 사후 분포 붕괴를 방지하기 위한 세심한 KL 비용 어닐링이 필요. vMF 분포는 강력한 성능을 유지하면서 더 간단하고 안정적인 학습 절차를 제공

- 생성 품질: 생성된 문장이 조건화된 레이블을 적절히 반영함. R^y를 활용한 미세조정으로 인공 데이터셋 분류 정확도가 76.5%에서 81.9%로 향상되어, 레이블 일관성 제약이 레이블에 충실한 출력을 생성하도록 효과적으로 학습시킴을 확인. R^z/R^μ는 다양성을 추가로 개선(distinct-2가 0.170에서 0.202로 상승)

의의

본 연구는 준지도 텍스트 시퀀스 매칭을 위한 최초의 교차 문장 생성 잠재 변수 모델을 도입하여, 생성을 통해 쌍의 두 문장을 공동으로 모델링하는 것이 문장을 독립적으로 처리하는 것보다 근본적으로 더 강력한 준지도 학습으로 이어짐을 증명했습니다. 핵심적인 아키텍처 통찰 — 생성 과정이 실제 데이터셋 구축 방식(소스와 레이블이 주어지면 타겟을 생성)을 반영해야 한다는 점 — 은 생성 모델과 판별 분류기 간의 훨씬 긴밀한 통합을 가능하게 하여, 공유 인코더 가중치를 통해 비레이블 데이터가 분류기에 의미 있는 학습 신호를 제공할 수 있게 합니다.

분류 성능을 넘어, 본 연구는 생성 텍스트의 품질과 다양성을 모두 향상시키는 새로운 의미 제약 조건(레이블 일관성, 잠재 정렬, 다양성)도 기여했습니다. 교차 문장 생성, 사후 분포 붕괴를 방지하는 vMF 잠재 공간, 의미적 미세조정 제약 조건 등의 아이디어는 저자원 NLP 환경에서의 데이터 증강 및 제어된 텍스트 생성을 위한 현대적 생성 접근법에도 여전히 유효합니다.

보다 넓은 관점에서, 이 논문은 구조화된 출력에 대한 준지도 학습의 중요한 원칙을 제시했습니다: 생성 모델은 개별 데이터 포인트를 독립적으로 모델링하는 것이 아니라 데이터의 관계적 구조를 포착해야 한다는 것입니다. 이 통찰은 이후 조건부 텍스트 생성, NLU를 위한 데이터 증강, 문장 쌍에 대한 대조 학습 등 후속 연구에서도 반복적으로 확인되었으며, 문장 간 관계를 명시적으로 모델링하는 것이 보다 효과적인 표현 학습으로 이어짐을 보여주었습니다. 본 연구는 자연어 처리 분야 최고 학술대회인 ACL 2019에서 발표되었으며, 이탈리아 피렌체에서 개최된 제57차 ACL 연례 학술대회에서 소개되었습니다.