한줄 요약

ENGinius는 플랜트 건설 엔지니어링(PCE)을 위해 특별히 설계된 최초의 대규모 언어 모델로, SOLAR-10.7B 기반의 4단계 이중 언어 학습 파이프라인과 16.5B 토큰의 도메인 데이터를 활용하여, Professional Engineer 벤치마크에서 67.5%를 달성해 GPT-4(64.0%)를 능가하고 KOPIA에서 58.91점으로 모든 베이스라인을 3-17% 상회합니다.

배경 및 동기

최근 대규모 언어 모델의 발전은 다양한 산업 분야에서 프로세스 자동화 및 최적화의 잠재력으로 주목받고 있습니다. 그러나 정유공장, 발전소, 화학 시설, 대규모 인프라를 아우르는 플랜트 건설 엔지니어링(PCE)에서의 LLM 도입은 고도로 전문화된 산업 특성과 도메인 특화 학습 및 평가를 위한 자원 부족으로 인해 매우 제한적인 상황입니다.

플랜트 건설 엔지니어링의 핵심 과제:

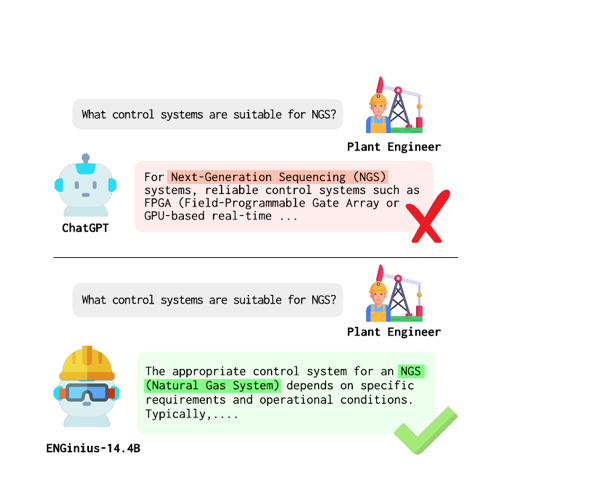

- 고도로 전문화된 도메인: PCE는 기계, 전기, 배관, 토목, 건축, 계장 분야에 걸친 복잡한 기술 용어를 포함하며, 범용 LLM은 이를 정확히 처리하지 못합니다. 예를 들어, ChatGPT의 PCE 특화 약어 인식 정확도는 48.4-55.6%에 불과한 반면, 의학/금융/법률 용어는 86-100%를 기록합니다.

- 학습 자원 부족: 의학이나 법학과 달리, PCE에는 LLM 학습을 위한 공개 도메인 특화 코퍼스나 명령어 데이터셋이 사실상 존재하지 않습니다. 권위 있는 정보는 전문 기관의 저작권 보호를 받으며 구독 기반 텍스트 검색 서비스를 통해서만 접근 가능합니다.

- 평가 벤치마크 부재: 본 연구 이전에는 플랜트 건설 작업에 대한 LLM 성능을 평가하기 위한 벤치마크가 전무하여 도메인 역량 측정이 불가능했습니다.

- 이중 언어 요구사항: 한국 엔지니어링 기업은 글로벌하게 운영되며, 기술 문서, 사양서, 국제 협업을 위한 원활한 한국어-영어 커뮤니케이션이 필수적입니다. 도메인 특화 언어는 다국어 또는 코드 스위칭 환경에서 자주 사용됩니다.

ENGinius는 도메인 데이터 구축(16.5B 토큰)을 위한 체계적 절차, SOLAR-10.7B를 14.4B 파라미터로 확장하는 다단계 모델 학습 파이프라인, 그리고 플랜트 건설 엔지니어링 도메인에 특화된 최초의 벤치마크(KOPIA 및 PE)를 제시함으로써 이러한 모든 과제를 해결합니다.

제안 방법: 4단계 학습 파이프라인

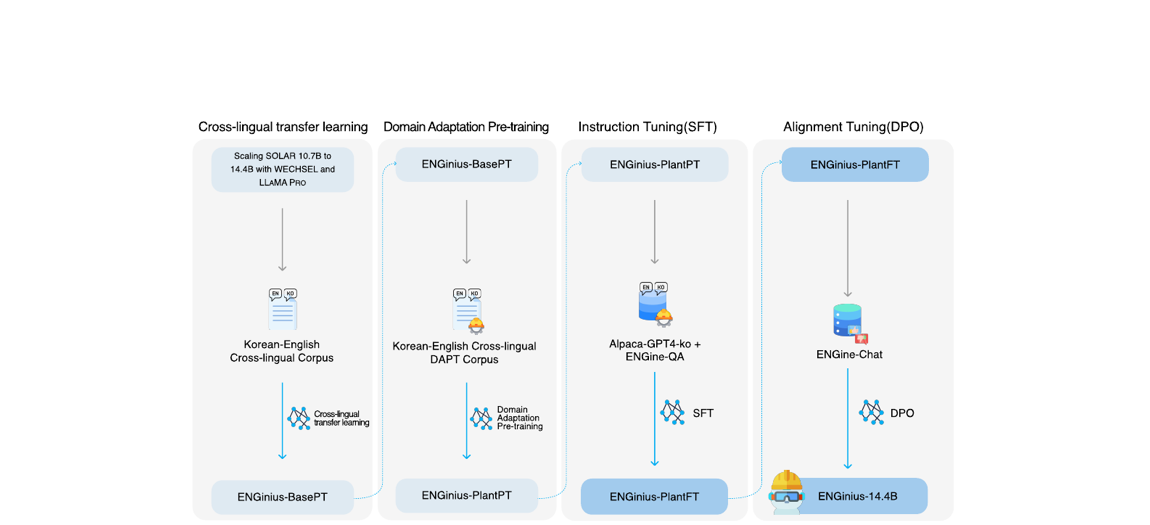

ENGinius는 SOLAR-10.7B -- Llama-2 13B, Mistral 7B 등을 평가한 후 모델 크기와 다국어 적응성의 최적 균형을 기준으로 선택 -- 을 도메인 특화 이중 언어 모델로 변환하는 4단계 학습 파이프라인을 사용하여 최종적으로 ENGinius-14.4B를 생성합니다.

도메인 특화 벤치마크: KOPIA와 PE

본 논문은 플랜트 건설 엔지니어링을 위한 최초의 평가 도구인 두 가지 객관식 문항(MCQ) 벤치마크를 도입합니다:

- KOPIA 벤치마크 (한국어): 한국플랜트산업협회(KOPIA)와 협력하여 개발되었습니다. 기계 및 배관 엔지니어링을 다루며, 용어, 기술 표준, 공정 지식에 관한 1,000개의 전문가 검증 시험 문항으로 구성됩니다. 공개 배포가 계획되어 있습니다.

- Professional Engineer (PE) 벤치마크 (영어): 실제 PE 자격시험을 기반으로 하며, PE Code(코드 지식), PE Calculation(고급 엔지니어링 계산), PE General(개념적 이해) 세 범주에 걸친 80개 문항으로 구성됩니다. 약 65점이 일반적으로 합격 기준으로 간주됩니다.

실험 결과

저자들은 LLM-as-a-judge 프레임워크(LLaMA3-70B를 판정 모델로 사용)를 활용하여 모델당 20회의 독립 실행을 수행하고 상위 5개 결과의 평균으로 최종 점수를 산출합니다.

KOPIA 벤치마크 (한국어, 플랜트 엔지니어링)

| 모델 | 기계 | 배관 | 평균 | ENGinius 대비 차이 |

|---|---|---|---|---|

| Gemma2-9B-it | 58.64 | 59.39 | 57.89 | -2.13 (-3.6%) |

| Orion-14B-Chat | 51.96 | 52.32 | 51.61 | -8.41 (-15.0%) |

| SOLAR-10.7B | 50.65 | 53.13 | 48.17 | -10.12 (-17.2%) |

| ENGinius-14.4B | 60.77 | 62.63 | 58.91 | - |

Professional Engineer (PE) 벤치마크 (영어)

| 모델 | PE Code | PE Cal | PE General | 평균 | ENGinius 대비 차이 |

|---|---|---|---|---|---|

| Orion-14B-Chat | 41.33 | 20.00 | 52.26 | 36.50 | -31.0 (-45.9%) |

| GPT-3.5-turbo | 60.00 | 47.06 | 45.16 | 48.75 | -18.75 (-27.8%) |

| Gemma2-9B-it | 72.00 | 34.71 | 59.99 | 51.50 | -16.0 (-23.7%) |

| SOLAR-10.7B | 72.00 | 40.59 | 54.83 | 52.00 | -15.5 (-23.0%) |

| GPT-4 | 66.67 | 52.94 | 74.84 | 64.00 | -3.5 (-5.2%) |

| ENGinius-14.4B | 100 | 46.47 | 74.84 | 67.5 | - |

- PE에서 GPT-4 능가: ENGinius-14.4B는 PE 벤치마크에서 평균 67.5를 달성하여 GPT-4의 64.0을 넘어서며, Professional Engineer 자격시험의 ~65 합격 기준을 초과합니다. 특히 PE Code에서 만점(100)을 기록하여 엔지니어링 코드 지식의 탁월한 숙달을 보여줍니다.

- KOPIA에서 압도적 우위: ENGinius는 한국어 KOPIA 벤치마크에서 모든 베이스라인을 3-17% 상회하며, 기계 및 배관 엔지니어링 하위 범주 모두에서 강력한 이중 언어 도메인 역량을 확인합니다.

- GPT-4의 계산 분야 강점: GPT-4는 PE Calculation에서 더 높은 점수(52.94 vs. 46.47)를 기록하며, 이는 GPT-4의 강력한 수학적 추론 능력에 기인합니다 -- ENGinius의 보다 컴팩트한 14.4B 아키텍처와의 트레이드오프입니다.

- DAPT의 핵심적 역할: 어블레이션 결과, ENGinius-PlantPT는 도메인 적응 사전학습 이후 ENGinius-BasePT를 일관되게 능가하며, KOPIA Pipe 점수가 44.85에서 54.36으로, PE General이 38.71에서 54.84로 상승합니다.

- 각 단계의 기여: 4단계 파이프라인은 누적적 향상을 보여줍니다 -- 이중 언어 확장이 언어 기반을 제공하고, DAPT가 도메인 지식을 주입하며, 명령어 튜닝이 실무 과제에 동작을 정렬하고, DPO가 전문가 피드백 기반으로 출력 품질을 개선합니다.

실제 산업 적용

ENGinius는 주요 기업에서 실제 PCE 워크플로우에 활발히 배포되어 실질적인 산업적 영향을 입증하고 있습니다:

- 전문가 시스템: ENGinius는 Retrieval-Augmented Generation(RAG)을 활용하여 기술 질문에 정확한 답변을 검색함으로써 도메인 전문가 역할을 수행하며, 내부 설계 기준과 기술 코드를 참조하여 EPA 및 CFR 규정 등 엔지니어링 표준에 부합하는 정보에 기반한 권고사항을 생성합니다.

- 자동 문서 분석: ENGinius는 계약 리스크 평가(과거 데이터에서 의미적으로 유사한 조항 검색)와 변경 사항 감지를 통해 복잡한 입찰 초청서(ITB) 문서의 검토를 효율화하여 고객 요구사항의 변화를 식별합니다.

- 고객 서한 및 편차 보고서 생성: 모델은 이전에 승인된 문서를 참조하여 프로젝트 기준에 부합하는 초안을 생성함으로써 공식 프로젝트 서신을 작성합니다.

- 문서 번역: ENGinius는 이중 언어 역량을 활용하여 PCE 기술 문서의 다국어 번역을 수행하며, 범용 번역 도구가 빈번히 오역하는 도메인 특화 용어를 정확히 처리합니다.

의의

ENGinius는 경제적으로 중요하지만 NLP 연구에서 기술적으로 미개척된 분야인 플랜트 건설 엔지니어링 산업에 대규모 언어 모델의 역량을 도입하는 선구적 시도입니다. 그 기여는 단일 모델을 넘어 확장됩니다:

- 플랜트 건설을 위한 최초의 도메인 특화 LLM: 정유공장부터 발전소까지 대규모 인프라 프로젝트를 다루는 산업에서 AI 지원 엔지니어링 워크플로우의 가능성을 열었습니다. ENGinius는 이미 실제 PCE 운영 현장에서 활발히 배포되어 사용되고 있습니다.

- 재현 가능한 방법론: 10개 소스 범주에서 16.5B 토큰의 데이터 구축 및 4단계 모델 학습을 위한 체계적 절차는 유사한 데이터 부족 문제에 직면한 다른 전문 산업 도메인에도 적용할 수 있는 청사진을 제공합니다.

- 최초의 도메인 벤치마크: KOPIA(한국어 MCQ 1,000개)와 PE(영어 자격시험 수준 80문항)는 플랜트 건설 작업에 대한 LLM 성능을 처음으로 측정하고 비교할 수 있게 하여 중요한 평가 공백을 메웁니다.

- 이중 언어 산업 NLP: WECHSEL과 LLaMA PRO를 활용한 효과적인 이중 언어 도메인 모델 구축 방법을 보여주며, 기술 커뮤니케이션이 다국어에 걸치는 글로벌 시장에서 운영되는 한국 기업에 특히 유용합니다.

- 자격시험 수준의 역량: ENGinius는 PE 시험 합격 기준을 넘어서며 GPT-4를 능가하여, 잘 최적화된 14.4B 파라미터 도메인 모델이 전문 분야 과제에서 훨씬 큰 범용 모델을 능가할 수 있음을 입증합니다.