한줄 요약

트랜스포머 셀프 어텐션 헤드를 고유 속성 기반으로 순위화하고 앙상블하여, 레이블 데이터나 개발 세트 없이도 경쟁력 있는 구문 분석 성능을 달성하는 완전 비지도 구문 분석 방법으로, 사전학습 언어 모델이 암묵적으로 학습한 문법 분석까지 가능하게 합니다.

배경 및 동기

구문 분석(constituency parsing)은 문장을 명사구(NP), 동사구(VP), 전치사구(PP) 등 중첩된 하위 구(phrase)로 분해하는 자연어처리의 핵심 과제입니다. 전통적으로 Penn Treebank(PTB)과 같은 약 40,000개 문장에 대한 고비용 트리뱅크 주석이 필요하며, 비지도 구문 분석은 레이블 데이터 없이 이러한 계층적 구조를 복원하는 것을 목표로 하지만 지도학습 방법에 비해 성능이 크게 뒤처져 왔습니다.

한편, BERT와 같은 사전학습 언어 모델(PLM)은 내부 표현에 놀라울 정도로 풍부한 구문 정보를 인코딩하는 것으로 밝혀져 왔습니다. 자연스러운 질문이 떠오릅니다: 구문 특성을 단순히 프로빙하는 것이 아니라, PLM의 어텐션 패턴에서 직접 구문 트리를 추출할 수 있을까? Kim et al. (2020)의 선행 연구에서 개별 BERT 어텐션 헤드가 구문 트리를 생성할 수 있음을 보였으나, 최적 헤드를 선택하기 위해 레이블된 개발 세트가 필요했습니다 — 비지도 전제를 훼손하는 치명적 한계였습니다.

본 연구가 해결하는 핵심 문제:

- 프로빙의 한계: PLM의 구문 지식을 분석하는 기존 연구는 외부 프로빙 분류기(예: 은닉 상태에 대한 선형 프로브)나 특정 테스트 세트(예: 주어-동사 일치)에 의존했으나, 이러한 방법은 자체적으로 교란 요인을 도입하며 — 높은 프로빙 성능이 모델의 지식이 아닌 프로브 자체의 용량을 반영할 수 있음 — 직접적으로 구문 트리를 생성할 수 없습니다.

- 개발 세트 의존성: PLM을 활용하는 기존 비지도 구문 분석 방법(예: 오라클 비교를 통한 최적 어텐션 헤드 선택)은 하이퍼파라미터 선택을 위해 레이블된 개발 세트가 필요하여, 진정한 비지도 설정을 훼손합니다. 실질적으로 “비지도” 파싱을 위해 트리뱅크가 필요하다는 모순적 요구 사항입니다.

- 저자원 언어 적용성: 트리뱅크가 전혀 없는 저자원 언어 — 전 세계 7,000개 이상 언어의 대다수 — 에는 개발 데이터 없이 작동하는 방법이 필수적이지만, 기존 접근법은 이 제약 하에서 작동할 수 없었습니다.

- 해석 가능성 부재: 서로 다른 PLM이 암묵적으로 학습한 문법을 단순한 트리 정확도가 아닌 문법 규칙 수준에서 인간 주석 트리뱅크와 정량적으로 비교할 원칙적 방법이 부재했습니다.

본 논문은 (1) 어텐션 패턴에서 직접 구문 트리를 추출하고, (2) 개발 세트나 레이블 데이터가 필요 없으며, (3) 다양한 PLM과 언어에 걸쳐 작동하고, (4) 유도된 PCFG를 통한 문법 수준 분석을 가능하게 하는 방법을 제안하여 네 가지 문제를 모두 해결합니다. 핵심 통찰은 구문 정보가 여러 어텐션 헤드에 분산되어 있으며, 트리 구조 품질에 기반한 비지도 기준이 가장 유용한 헤드를 식별하고 결합할 수 있다는 것입니다.

제안 방법

본 접근법은 어텐션 행렬에서 스팬 점수를 계산하고, 비지도 방식으로 가장 구문적으로 유용한 헤드를 순위화 및 선택한 뒤, 탐욕적 하향식 알고리즘으로 트리를 구축하는 세 단계로 구성됩니다. 선택적 네 번째 단계에서는 분석 목적의 명시적 문법을 유도합니다.

레이어 l의 각 어텐션 헤드 h에 대해, 길이 n인 문장 내 가능한 모든 텍스트 스팬 (i, j)의 구문 친화도 점수를 계산합니다. n × n 크기의 어텐션 행렬 A가 주어지면, 스팬 점수는 스팬 내부 토큰이 서로에게 얼마나 주의를 기울이는지(스팬 내부 어텐션 질량)와 외부 토큰에 대한 어텐션의 비율로 계산됩니다. 높은 점수는 해당 토큰들이 자기 완결적인 어텐션 클러스터를 형성함을 나타내며, 이는 구문적 구성소의 기대되는 특성입니다 — “the big red ball”과 같은 구 내의 단어들은 주로 서로에게 주의를 기울여야 합니다.

이 점수는 문장 내 모든 O(n2)개의 가능한 스팬에 대해 계산되어, 각 어텐션 헤드에 대한 완전한 스팬 점수 차트를 생성합니다. 이 차트는 CKY 파싱에서 사용하는 차트와 유사하지만, 학습된 문법 규칙이 아닌 사전학습된 어텐션 패턴에서 점수가 산출됩니다.

모든 어텐션 헤드가 구문을 인코딩하는 것은 아닙니다 — 많은 헤드가 위치 패턴(예: 이전 또는 다음 토큰에 주의), 구두점, 또는 의미적 관계에 주의를 기울입니다. 본 논문은 각 헤드가 유도한 트리의 구조적 속성에 기반한 비지도 순위화 기준을 도입합니다.

이 기준은 헤드가 코퍼스 전체에서 생성하는 트리들의 분기 엔트로피(branching entropy)를 측정합니다: 항상 좌분기 트리(항상 첫 단어를 분리)나 항상 우분기 트리(마지막 단어를 분리)를 생성하는 헤드는 낮은 점수를 받습니다. 이러한 트리는 자명하게 퇴화되어 실제 구문 정보를 담지 않기 때문입니다. 반면, 실제 문장 구조에 따라 때로는 좌분기, 때로는 우분기하는 등 다양하고 비자명한 분기 패턴을 보이는 헤드는 높은 점수를 받으며, 이 변동성은 구문에 대한 진정한 민감성을 나타냅니다.

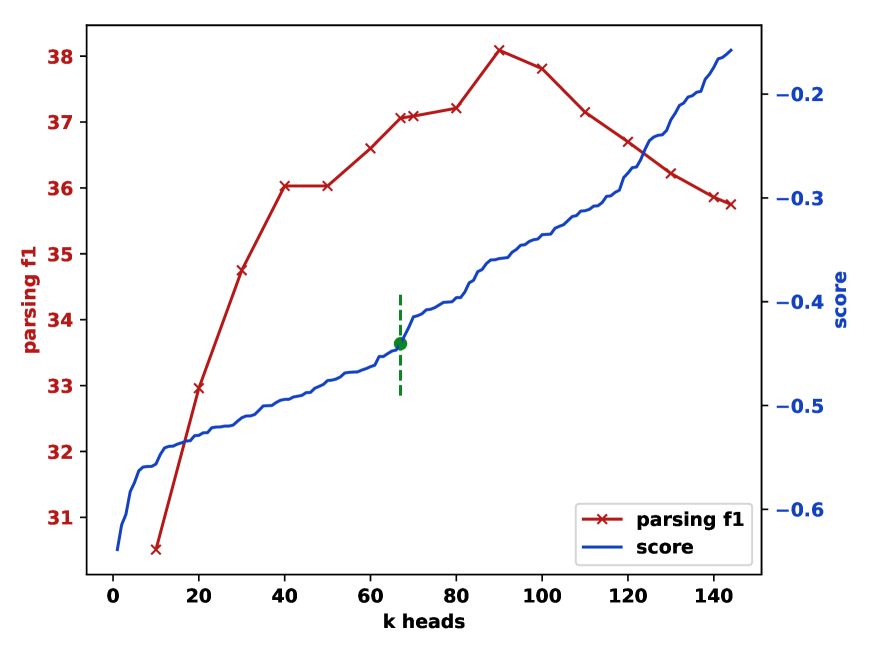

상위 K개 헤드(일반적으로 K = 5–15)의 스팬 점수를 요소별로 평균하여, 서로 다른 헤드와 레이어의 상보적 구문 정보를 활용한 강건한 복합 신호를 생성합니다. 이 순위화에는 레이블 데이터나 개발 세트가 전혀 필요 없으며 — 대상 도메인의 비레이블 텍스트만 있으면 됩니다.

앙상블된 스팬 점수를 바탕으로, 탐욕적 하향식 알고리즘이 재귀적으로 구문 트리를 구축합니다. 전체 문장 스팬 (1, n)에서 시작하여, 두 결과 하위 스팬의 점수 합 score(1, k) + score(k+1, n)을 최대화하는 분할점 k를 찾습니다. 그런 다음 각 하위 스팬에 대해 재귀적으로 진행하여, 개별 토큰(길이 1의 스팬)에 도달할 때까지 계속합니다.

이를 통해 레이블 없는 이진 구문 트리가 생성됩니다. 알고리즘의 시간 복잡도는 문장당 O(n2)로(재귀 각 수준에서의 선형 탐색), 차트 파싱 접근법에 비해 매우 효율적입니다. 결과 트리는 이진화되어 — 각 내부 노드가 정확히 두 자식을 가짐 — PTB의 이진화된 골드 스탠다드 트리와의 평가에 표준적입니다.

추가 분석 도구로, 유도된 구문 트리를 지도 신호로 사용하여 Kim et al. (2019)의 compound PCFG 프레임워크를 따르는 신경 PCFG(확률적 문맥자유문법)를 학습합니다. 신경 PCFG는 신경망으로 매개변수화된 명시적 생성 규칙(예: S → NP VP, NP → DT NN)과 관련 확률을 학습합니다.

이를 통해 서로 다른 PLM이 포착한 암묵적 문법을 정량적으로 비교할 수 있습니다: BERT, GPT-2, XLNet 등에서 유도된 트리로 각각 별도의 PCFG를 학습한 뒤, 결과 규칙 분포를 PTB의 인간 주석 문법과 비교합니다. 이 비교를 통해 각 모델이 어떤 구 유형을 잘 포착하는지(예: NP vs. VP), 어떤 구문이 문제가 되는지, 서로 다른 PLM 아키텍처의 암묵적 문법이 어떻게 체계적으로 다른지를 드러냅니다.

실험 결과

Penn Treebank의 WSJ10(10단어 이하 문장) 및 WSJ 테스트 세트(섹션 23, 전체 길이)에서 전통적 비지도 파서 및 PLM 기반 접근법과 비교하여 평가하였습니다. BERT(base/large, cased/uncased), GPT-2, XLNet, RoBERTa 등 다양한 PLM을 테스트하였습니다. 모든 결과는 비레이블 F1을 평가 지표로 사용합니다.

PTB 비지도 구문 분석 F1 (개발 세트 미사용)

| 방법 | WSJ10 F1 | WSJ Test F1 |

|---|---|---|

| PRPN (Shen et al., 2018) | 70.5 | 38.3 |

| ON-LSTM (Shen et al., 2019) | 65.1 | 47.7 |

| URNNG (Kim et al., 2019) | 73.6 | 51.6 |

| 단일 최적 헤드 (오라클) | — | 52.1 |

| Heads-up! (본 방법, BERT-base) | 69.5 | 49.4 |

| Heads-up! (본 방법, BERT-large) | 71.3 | 50.8 |

“단일 최적 헤드 (오라클)” 결과는 어느 헤드가 최선인지 식별하기 위해 레이블된 개발 세트가 필요하므로 진정한 비지도가 아닙니다. 제안 방법은 이러한 지도 없이 BERT-large로 50.8 F1을 달성하여, 오라클 헤드 선택과의 차이를 1.3 F1 이내로 좁힙니다.

다양한 PLM에서의 성능

| 사전학습 모델 | WSJ Test F1 | 전체 헤드 수 | 선택된 K |

|---|---|---|---|

| BERT-base-cased | 49.4 | 144 | ~10 |

| BERT-base-uncased | 48.2 | 144 | ~10 |

| BERT-large-cased | 50.8 | 384 | ~15 |

| GPT-2 | 40.1 | 144 | ~10 |

| XLNet-base | 45.7 | 144 | ~10 |

| RoBERTa-base | 47.3 | 144 | ~10 |

레이어별 분석

PLM에서 구문은 어디에 존재하는가?

헤드 순위화 분석은 테스트된 모든 모델에서 명확한 패턴을 드러냅니다:

- 초기 레이어 (1–3층): 위치 기반 어텐션 헤드가 지배적으로, 이전 토큰, 다음 토큰, 또는 첫 번째 토큰에 주의를 기울입니다. 이들은 거의 좌분기 또는 우분기 트리를 생성하여 순위화 기준에서 낮은 점수를 받습니다.

- 중간 레이어 (4–8층): 가장 높은 순위의 헤드를 포함합니다. 이 헤드들은 실제 구문 구조와 상관되는 다양한 분기 패턴을 보이며, 종종 특정 구성소 유형에 특화됩니다(예: 한 헤드는 NP 식별에 특히 뛰어나고 다른 헤드는 VP를 잘 포착).

- 후기 레이어 (9–12층): 어텐션 패턴이 더 확산되고 의미 지향적입니다. 이 헤드들은 긴밀한 구문 클러스터를 형성하기보다 긴 거리에 걸친 관련 단어에 주의를 기울이는 경향이 있습니다(예: 상호참조와 유사한 패턴).

문법 유도 분석

신경 PCFG 분석은 서로 다른 PLM이 문장 구조를 어떻게 개념화하는지에 대한 통찰을 제공합니다:

- BERT vs. PTB 문법: BERT의 유도 문법은 동사구에 대해 더 평탄한 구조를 생성하는 경향이 있으며 — PTB의 VP 내부 주어 분석보다 주어와 동사를 더 자주 병합합니다. 이는 BERT가 절 수준 구조를 언어학적 관례와 다르게 조직함을 시사합니다.

- NP 식별: 테스트된 모든 PLM은 명사구 경계에 대해 PTB와 상대적으로 강한 일치를 보입니다. NP는 가장 일관되게 식별되는 구성소 유형 중 하나로, 어텐션 메커니즘이 자연스럽게 관사, 형용사, 핵심 명사를 클러스터링하기 때문일 가능성이 높습니다.

- PP 부착: 전치사구 부착은 PLM 유도 트리에서도 모호하게 나타나며, 이는 인간 파싱과 NLP 시스템 모두에서 잘 알려진 난제를 반영합니다.

- 개발 세트 없이 경쟁력 달성: 레이블 데이터를 전혀 사용하지 않음에도, PRPN 및 ON-LSTM과 같은 비지도 파서와 경쟁력 있는 F1 점수를 달성하며, 변분 추론을 사용하는 더 복잡한 학습 절차의 URNNG에 근접합니다.

- 오라클과의 격차 해소: BERT-large는 오라클 단일 헤드 선택의 52.1 F1 대비 50.8 F1을 달성합니다. 제안된 비지도 순위화가 레이블 데이터 없이도 오라클 헤드 선택에 거의 필적하여, 분기 엔트로피 기준이 구문 품질의 효과적인 대리 지표임을 확인합니다.

- 헤드 앙상블이 단일 헤드보다 우수: 상위 K개 순위 헤드의 앙상블이 단일 헤드 사용보다(일부 구성에서는 오라클 선택 최적 헤드보다도) 일관되게 높은 성능을 보여, 구문 정보가 여러 헤드에 분산되어 있으며 상보적 신호의 결합이 유익함을 확인합니다.

- BERT > GPT-2 (구문 분석): 양방향 모델(BERT, RoBERTa)이 단방향 모델(GPT-2)보다 구문 분석에서 약 9 F1 포인트의 상당한 격차로 일관되게 우수합니다. 이는 양방향 어텐션이 중첩된 계층적 구성소 구조를 포착하는 데 핵심적임을 시사하며, 좌-우 모델은 구를 완성하는 미래 토큰에 주의를 기울일 수 없기 때문입니다.

- Cased vs. uncased: BERT-base-cased가 BERT-base-uncased보다 약간 우수하여(49.4 vs. 48.2), 대소문자 구분이 유용한 구문 단서(예: 문장 시작 단어, 고유명사)를 제공하여 파싱에 도움이 됨을 시사합니다.

- 효율성: 이 방법은 학습이 필요 없으며, PLM을 통한 단일 순전파와 문장당 O(n2) 파싱만 수행하므로, 대규모 적용에 충분히 빠릅니다. 전체 WSJ 테스트 세트 처리는 단일 GPU에서 수 분밖에 걸리지 않습니다.

의의

본 연구는 비지도 구문 분석과 PLM 해석 가능성의 교차점에서 여러 중요한 기여를 합니다:

- 진정한 비지도 구문 분석: 헤드 선택을 위해 개발 세트가 필요한 기존 PLM 기반 파싱 방법과 달리, 본 접근법은 레이블 데이터가 전혀 필요 없습니다. 이는 트리뱅크 주석이 존재하지 않는 저자원 언어에 직접 적용할 수 있음을 의미합니다 — 다국어 PLM을 원시 텍스트에 실행하기만 하면 구문 분석을 얻을 수 있습니다.

- 원칙적 PLM 분석: 구문 트리를 추출하고 이로부터 PCFG를 학습함으로써, 서로 다른 PLM에 인코딩된 구문 지식을 문법 규칙 수준에서 체계적으로 비교하는 방법을 제공합니다. 이는 프로빙 분류기를 넘어 이러한 모델이 암묵적으로 학습하는 문법의 종류와 인간 언어학 주석과의 차이점을 드러냅니다.

- 분산된 구문의 증거: 구문 정보가 여러 어텐션 헤드에 분산되어 있으며(단일 헤드에 집중되지 않음) 중간 레이어가 가장 구문적으로 유익하다는 발견은, 구문 민감 과제를 위한 모델 가지치기, 증류, 아키텍처 설계에 대한 후속 연구에 영향을 미쳤습니다. 이 레이어별 특성화(위치 → 구문 → 의미)는 PLM 해석 가능성 문헌에서 널리 인용되는 참조점이 되었습니다.

- 프로빙과 생성의 연결: 본 연구는 이전에 분리되어 있던 두 연구 흐름 — PLM의 구조적 프로빙(분석하되 출력을 생성하지 않음)과 비지도 문법 유도(파스를 생성하되 PLM을 활용하지 않음) — 을 연결합니다. 어텐션 헤드가 직접 경쟁력 있는 파스를 생성함을 보여줌으로써, 트랜스포머 내부에 대한 추출 기반 분석의 새로운 연구 방향을 개척했습니다.

- 실용적 기준선: 이 방법은 비지도 구문 분석의 강력한 제로 비용 기준선 역할을 합니다: 학습이 필요 없고, 레이블 데이터에 대한 하이퍼파라미터 튜닝이 필요 없으며, 추론 시 효율적으로 실행됩니다. 이는 새로운 언어나 도메인에서 구문 자원을 부트스트래핑하는 편리한 도구가 됩니다.