한줄 요약

Hanja-level SISG는 한자(Chinese character) n-gram을 Skip-gram 스코어링 함수에 통합하고, 선택적으로 사전 학습된 중국어 임베딩으로 초기화하여 교차언어 전이를 수행함으로써 한국어 단어 임베딩을 강화하며, 단어 유추, 단어 유사도, 뉴스 헤드라인 생성, 감성 분석 태스크에서 성능 향상을 달성합니다.

배경 및 동기

한국어와 중국어는 문화적, 역사적 이유로 깊은 연관성을 지닙니다. 중국어 문자와 매우 유사한 표의문자 체계인 한자는 1443년 한글이 창제되기 전까지 한국어 기록의 유일한 매체였습니다. 이러한 어원적 배경으로 인해, 상당 부분의 한국어 어휘가 한자어(Sino-Korean) -- 중국어에서 유래하여 한자와 한글 모두로 표기 가능한 단어 -- 로 분류되며, 현대 한국어에서는 한글 표기가 일반화되었습니다.

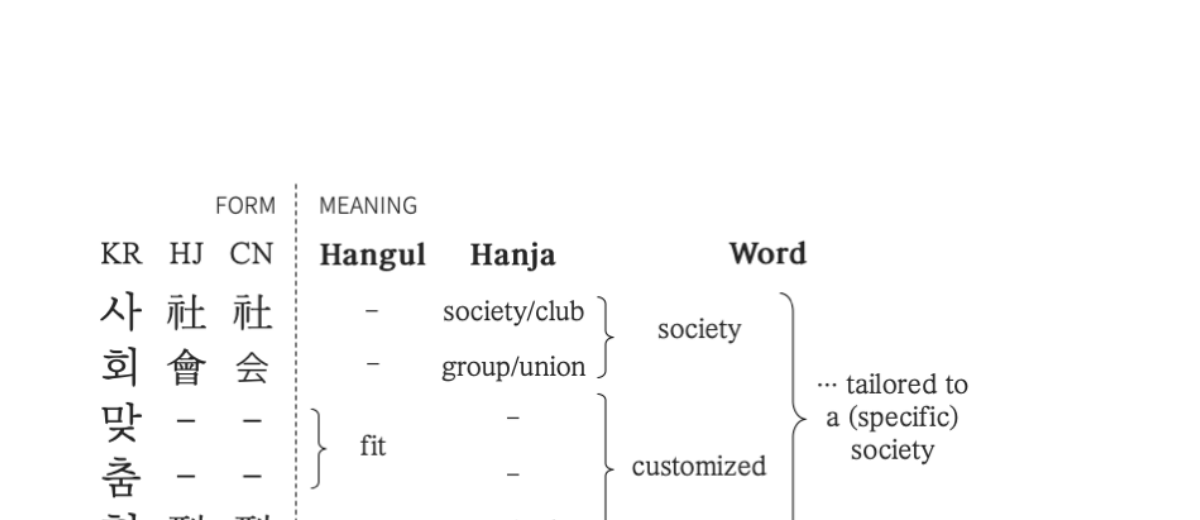

표음문자 vs. 표의문자: 한국어의 한글 문자는 표음문자로, 발음을 인코딩하지만 의미는 담지 않습니다. 반면 한자는 표의문자로, 각 글자가 고유한 어휘적 의미를 지닙니다. 예를 들어, "사회맞춤형"이라는 단어에서 한자 시퀀스 社會(사회)와 型(형/양식)은 의미를 직접 전달하지만, 한글 음절 "맞춤"(customized)에는 대응하는 한자가 없습니다. 이러한 한자의 의미적 풍부함은 한글 표면 형태만을 다루는 기존 단어 임베딩에서는 포착할 수 없습니다.

기존 하위단어 방법의 한계: 한국어 단어 표현을 위한 기존 접근법 -- 문자(음절) 수준 n-gram(Bojanowski et al., 2017)과 자모 수준 n-gram(Park et al., 2018) -- 은 표면 수준의 철자 패턴만을 포착하며, 한자 어원에 인코딩된 더 깊은 의미 구조는 놓칩니다. 한국어의 교착어적 특성으로 인해 이러한 표면 수준 방법만으로는 한국어 이해에 특화된 하위문자 및 문자 간 정보를 충분히 포착하기 어렵습니다.

핵심 통찰 -- 한자를 통한 교차언어 전이: 한자와 간체 중국어 문자는 깊은 뿌리를 공유하며 다수가 일대일 대응이 가능하므로, 한국어 단어를 한자로 매핑하면 중국어로의 다리가 형성됩니다. 이를 통해 문자 수준의 교차언어 지식 전이가 가능해집니다: 사전 학습된 중국어 문자 임베딩(Li et al., 2018)으로 한자 n-gram 벡터를 초기화하여, 병렬 코퍼스 없이도 언어 간 의미 지식을 주입할 수 있습니다. 이는 어원적 기반에 근거한 문자 수준 교차언어 전이 학습을 도입한 최초의 연구입니다.

본 논문의 핵심 가설은 간단하면서도 강력합니다: 한국어 모국어 화자들은 한자어의 모호성을 해소할 때 직관적으로 한자를 활용하는데, 이는 각 한자 표의문자가 한글 표음문자보다 더 풍부한 어휘적 의미를 담고 있기 때문입니다. 이 인간의 휴리스틱을 단어 임베딩에서 재현할 수 있을까요?

제안 방법

제안하는 모델 Hanja-level SISG(Hanja-level Subword Information Skip-Gram)는 스코어링 함수에 세 수준의 하위단어 정보를 점진적으로 통합하여 Skip-gram 프레임워크를 확장합니다. 기존 연구 -- SG(Mikolov et al., 2013), SISG(Bojanowski et al., 2017), Jamo-level SISG(Park et al., 2018) -- 위에 새로운 한자 n-gram 수준을 추가하는 구조입니다.

- 가산적 합성: 세 수준의 n-gram 벡터 모두 스코어링 함수에서 컨텍스트 벡터와의 내적으로 합산 -- 네거티브 샘플링으로 학습되는 표준 Skip-gram 목적함수의 깔끔하고 모듈적인 확장

- 분리된 어휘: 공유 BPE 어휘를 사용하는 접근법과 달리, 한자 n-gram은 한글 n-gram과 별도의 어휘를 구성하여 각 문자 체계의 고유한 의미 정보를 보존

- 자연스러운 폴백: 한자 매핑이 없는 단어(고유어, 외래어)의 경우 한자 n-gram 집합이 빈 상태가 되어, 문자 + 자모 표현으로 자연스럽게 폴백

- 오픈 소스: 코드와 사전 학습된 모델이 github.com/kaniblu/hanja-sisg에 공개되어 있음

실험 결과

본 방법은 내적 평가(단어 유추, 단어 유사도)와 두 가지 하류 태스크(한국어 뉴스 헤드라인 생성, 감성 분석)에서 평가되었습니다. 학습 코퍼스는 Park et al. (2018)의 데이터셋에 추가적인 데이터 정제(비한국어 문장 제거, 숫자 태그 통일)를 수행하여 사용하였습니다.

단어 유추 테스트

한국어 단어 유추 데이터셋(Park et al., 2018의 의미적/구문적 범주를 포함하는 10,000개 4중쌍)을 사용하며, 예측 벡터와 정답 유추 벡터 간의 코사인 거리(낮을수록 우수)를 측정합니다.

| 모델 | 의미적 | 구문적 | 전체 (평균) |

|---|---|---|---|

| SG | 0.42 | 0.49 | 0.45 |

| SISG(c) -- 음절 n-gram | 0.45 | 0.59 | 0.52 |

| SISG(cj) -- + 자모 n-gram | 0.39 | 0.48 | 0.44 |

| SISG(cjh3) -- + 한자 (1-3) | 0.34 | 0.45 | 0.39 |

| SISG(cjh4) -- + 한자 (1-4) | 0.34 | 0.45 | 0.40 |

| SISG(cjhr) -- 무작위 초기화 | 0.35 | 0.46 | 0.40 |

단어 유사도 테스트 (한국어 WS353)

단어 벡터 거리와 인간 주석 유사도 점수 간의 상관관계를 평가합니다. Pearson/Spearman 상관계수가 높을수록 우수합니다.

| 모델 | Pearson | Spearman |

|---|---|---|

| SG | 0.60 | 0.62 |

| SISG(c) -- 음절 n-gram | 0.62 | 0.61 |

| SISG(cj) -- + 자모 n-gram | 0.66 | 0.67 |

| SISG(cjh3) -- + 한자 (1-3) | 0.63 | 0.63 |

| SISG(cjh4) -- + 한자 (1-4) | 0.62 | 0.61 |

| SISG(cjhr) -- 무작위 초기화 | 0.65 | 0.64 |

한국어 뉴스 헤드라인 생성

840,205개의 한국어 뉴스 기사(2017년 1-2월 발행, 정치/스포츠/세계 등 균형 잡힌 카테고리)를 활용한 새로운 하류 태스크입니다. 인코더-디코더 모델(양방향 LSTM 인코더 + LSTM 디코더, 히든 크기 512, Bahdanau 어텐션)이 기사 본문의 처음 세 문장으로부터 헤드라인을 생성합니다. 단어 임베딩이 인코더를 초기화합니다. 데이터 분할은 학습/검증/테스트 = 8:1:1입니다.

| 임베딩 | BLEU-1 | BLEU-2 | BLEU-3 | BLEU-4 | PPL |

|---|---|---|---|---|---|

| 없음 (무작위) | 26.02 | 7.76 | 3.08 | 1.38 | 5.335 |

| SG | 30.33 | 10.20 | 4.29 | 1.98 | 4.122 |

| SISG(c) | 31.34 | 10.96 | 4.69 | 2.19 | 3.942 |

| SISG(cj) | 31.78 | 11.17 | 4.80 | 2.25 | 3.938 |

| SISG(cjh3) | 32.03 | 11.25 | 4.83 | 2.27 | 3.941 |

| SISG(cjh4) | 32.02 | 11.34 | 4.92 | 2.30 | 3.909 |

감성 분석 (NSMC)

네이버 영화 리뷰 감성 코퍼스(200K 리뷰, 긍정/부정 레이블; 100K/50K/50K 분할)에서 평가하였습니다. 기본 LSTM 인코더(히든 크기 300)와 피드포워드 + 소프트맥스 분류기를 사용하여 입력 임베딩의 효과를 분리하였습니다. 결과는 서로 다른 랜덤 시드로 3회 실행한 평균입니다.

| 임베딩 | 정확도 | 정밀도 | 재현율 | F1 |

|---|---|---|---|---|

| SISG(c) | 77.43 | 75.89 | 80.41 | 78.08 |

| SISG(cj) | 83.16 | 82.36 | 84.66 | 83.50 |

| SISG(cjh3) | 81.61 | 81.23 | 82.28 | 81.75 |

| SISG(cjh4) | 82.25 | 82.57 | 81.77 | 82.17 |

- 유추에서의 큰 향상: SISG(cjh3)가 최고 전체 유추 점수(평균 코사인 거리 0.39)를 달성하여, 자모 수준 SISG(0.44)를 포함한 모든 기준선을 크게 상회하며, 의미적 유추에서 가장 큰 향상을 보임

- 교차언어 전이가 유추에 도움: 사전 학습된 중국어 초기화(SISG(cjh3): 0.39)가 무작위 초기화(SISG(cjhr): 0.40)를 상회하여, 한자-중국어 다리를 통한 지식 전이가 효과적임을 확인

- 단어 유사도에서의 트레이드오프: 한자 수준 모델이 순수 문자 수준 SISG(c)보다 유사도에서 개선되지만, 자모 수준 SISG(cj)를 능가하지는 못함 -- 이는 비교적 작은 WS353 평가 데이터셋의 통계적 편향 가능성에 기인할 수 있음

- 일관된 헤드라인 생성 향상: SISG(cjh4)가 최고 BLEU-4(2.30)과 최저 퍼플렉시티(3.909)를 달성. 뉴스 기사와 같은 격식체 한국어 텍스트가 더 많은 한자어를 포함하므로 한자 인식이 유리하게 작용하는 것으로 설명됨

- 감성 분석에서도 경쟁력: NSMC(한자어가 적은 구어/비격식 텍스트)에서는 SISG(cj)가 우위이나, 한자 수준 모델도 경쟁력을 유지하며 문자 전용 SISG(c)를 크게 상회하여 범용적 적용 가능성을 입증

의의

본 논문은 언어 고유의 어원 지식이 더 나은 단어 표현을 구축하는 데 있어 가치 있고 충분히 활용되지 않은 자원임을 설득력 있게 보여줍니다. 주요 기여와 시사점은 다음과 같습니다:

- 최초의 어원 기반 교차언어 전이: 어원적 기반에 근거한 문자 수준 교차언어 전이 학습을 최초로 도입한 연구로, 공유 BPE 어휘 대신 분리된 어휘 접근법을 사용합니다. 한자를 한국어와 중국어 사이의 다리로 활용하여, 병렬 데이터 없이 사전 기반 문자 매핑만으로 새로운 형태의 전이를 실현합니다.

- 표면적 토큰화를 넘어서: 대부분의 하위단어 접근법(BPE, 음절, 자모)이 표면 철자에 집중하는 반면, 본 연구는 더 깊은 표의문자적 구조를 통합하면 특히 격식체/문어체 한국어 태스크에서 더 나은 표현을 얻을 수 있음을 보여줍니다. 이러한 통찰은 다층적 어원 역사를 가진 다른 언어(예: 일본어의 漢字, 베트남어의 漢喃)에도 일반화 가능합니다.

- 새로운 평가 패러다임: 한국어 뉴스 헤드라인 생성(84만 기사)을 하류 평가 태스크로 도입하여, 당시 가용했던 소규모 내적 평가 데이터셋을 보완하는 실용적이고 대규모의 한국어 NLP 벤치마크를 제공합니다.

- 실용적 단순성: Skip-gram의 모듈적 확장으로, 스코어링 함수에 한자 n-gram을 추가하는 것만으로 학습 파이프라인 변경이 필요 없습니다. 코드와 모델이 공개되어 있어 쉽게 채택할 수 있습니다.

- 솔직한 한계 논의: 한자 태거에 대한 의존성(특히 구어/비격식 텍스트에서 오류 발생 가능)을 투명하게 논의하며, 외부 태거에 의존하지 않는 종단간(end-to-end) 시스템 개발을 중요한 향후 연구 방향으로 제시합니다.